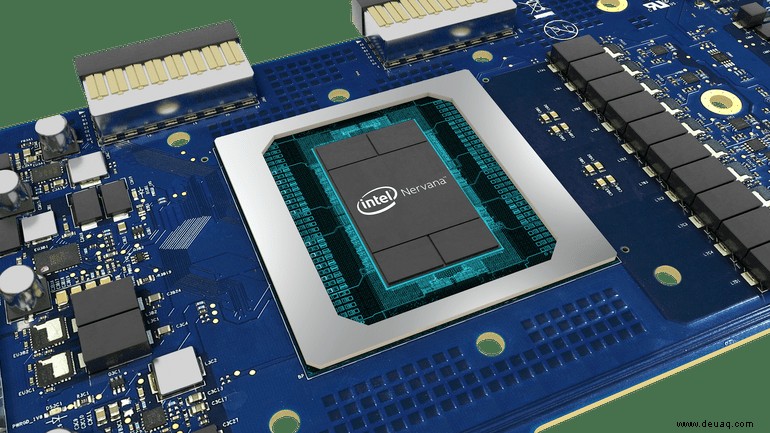

Intel hat den Nervana Neural Network Processor (NNP) vorgestellt – den ersten kommerziell verfügbaren Chip, der speziell für Deep-Learning-Anwendungen konzipiert wurde. Überraschend: Die Entwicklung erfolgte in enger Zusammenarbeit mit Facebook.

Siehe verwandte Artikel: KI versus maschinelles Lernen: Was ist der Unterschied? Aktzeichnen und maschinelles Lernen: Ein Interview mit der Künstlerin Anna Ridler Die Regierung ist nicht bereit für die Auswirkungen der künstlichen Intelligenz, behaupten Abgeordnete

Die Nervana NNP-Reihe, offiziell "Lake Crest" genannt, ist Intels Reaktion auf den Boom des maschinellen Lernens und eine direkte Konkurrenz zu Nvidias KI-Hardware, die kürzlich zu Rekordumsätzen geführt hat.

Mit diesem Chipsatz zielt Intel darauf ab, den Markt für KI-Rechenzentren zu erobern – ähnlich wie bei herkömmlichen Servern, wo das Unternehmen einen Marktanteil von 96 % hält, wie The Verge berichtet. Als Experten für High-Performance-Computing positioniert sich Intel ideal, um vom Wachstum des Deep Learnings zu profitieren.

Unklar über den Unterschied zwischen KI und maschinellem Lernen? Hier eine klare Einführung.

Die Basis bildet Intels Übernahme des Deep-Learning-Startups Nervana Systems im August 2016 für über 400 Millionen US-Dollar (ca. 303 Millionen Pfund). Experten prognostizierten bereits damals Intels Einstieg in Deep Learning für Rechenzentren.

Überraschend: Facebook spielte eine Schlüsselrolle. "Wir freuen uns, dass Facebook seine technischen Erkenntnisse teilt, während wir diese neue KI-Hardwaregeneration launchen", schrieb Intel-CEO Brian Krzanich in seinem Blogbeitrag zur Ankündigung.

Details zu Facebooks Beiträgen bleiben vage, doch als KI-Gigant mit massiven Deep-Learning-Anforderungen – etwa für personalisierte Feeds und gezielte Werbung – bringt das Netzwerk unschätzbare Praxiserfahrung ein.

Zu den Spezifikationen: Intel verspricht eine bis zu 100-fache Reduzierung der Trainingszeit für Deep-Learning-Modelle im Vergleich zu GPUs innerhalb der nächsten drei Jahre – mit dem 100-fachen Ziel für 2020.